- ニューラルネットワークとは

- ニューロンに飛び込む

- ニューラルネットワークはどのように任意の関数をシミュレートしますか

- なぜニューラルネットワークが必要なのですか

- ニューラルネットワークの構築方法

- 完全に接続されたニューラルネットワーク

- グラフィカルツールを使用してニューラルネットワークを設計する

- 出力層の「活性化関数」

- ニューラルネットワークをトレーニングする方法

- 学習アルゴリズムと原理

- ニューラルネットワークをゼロから構築してトレーニングする

- PyTorchを使用してコードを書き直します

- グラフィカルツールを使用してニューラルネットワークをトレーニングする

- ニューラルネットワークのいくつかの重要な問題

- ネットワーク構造

- 過剰適合

- アンダーフィッティング

- 過剰適合と過適合

- 初期化

- 勾配消失と爆発勾配

- 畳み込みニューラルネットワーク(CNN)

- 1D畳み込み

- 1D畳み込み実験

- 1D-pooling

- 1D-CNN実験

- 2D-CNN

- 2D-CNN実験

- リカレントニューラルネットワーク(RNN)

- バニラRNN

- Seq2seq, Autoencoder, Encoder-Decoder

- 高度なRNN

- RNN分類実験

- 自然言語処理

- Embedding: 記号を値に変換する

- テキスト分類1

- テキスト分類2

- TextCNN

- エンティティの認識

- 単語のセグメンテーション、品詞のタグ付け、チャンク

- 実行中のシーケンスタグ付け

- 双方向RNN

- BI-LSTM-CRF

- 注意

- 言語モデル

- n-gramモデル: 単語

- n-gramモデル: 2-gram

- n-gramモデル: 3-gram

- RNN言語モデル

- Transformer言語モデル

- 線形代数

- ベクター

- マトリックス

- 行列の乗算に飛び込む

- テンソル

ニューラルネットワークはどのように任意の関数をシミュレートしますか

概要

ニューラルネットワークが強力である理由は、その強力なシミュレーション能力にあります。理論的には、無限に小さなエラーで任意の関数をシミュレートできます。

言い換えれば、ニューラルネットワークを使用して任意の関数を構築し、任意のアルゴリズムを取得できます。

ここでは、直感的な理解を得るために、いくつかの視覚的な例を使用します。

単項関数のシミュレーション

直線

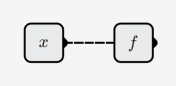

これは最も単純なケースであり、活性化関数のないニューロンを使用してシミュレートできます。

パラメータを調整することにより、任意の直線をシミュレートできます。

ステップ関数

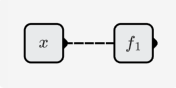

sigmoid活性化関数を持つニューロンを使用してシミュレートします。

パラメータが増加し続けると、ニューラルネットワークは徐々に関数に近づきます。

矩形パルス関数

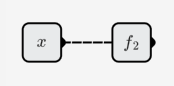

それをいくつかのステップに分けます。

- 単一のニューロンを使用して、関数の左半分をシミュレートします。

- 単一のニューロンを使用して、関数の右半分を(逆さまに)シミュレートします。

- 別のニューロンを使用して、最初の 2 つのステップの画像を合成します

得られた結果は、目的関数の適切な近似です。

その他の単項関数

長方形のインパルス関数を使用すると、積分の原理と同じように、他の任意の関数を簡単に近似できます。

実験

Broken Lineミッションを完了し、各ニューロンに対応する関数を観察します。

二関数のシミュレーション

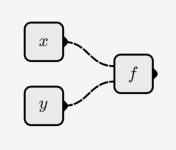

飛行機

これは最も単純なケースであり、活性化関数のないニューロンを使用してシミュレートできます。

のパラメータを調整することにより、任意の平面をシミュレートできます。

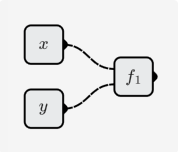

バイナリステップ関数

sigmoid活性化関数を持つニューロンを使用してシミュレートします。

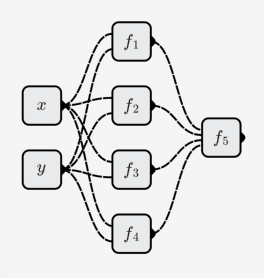

バイナリ矩形インパルス関数

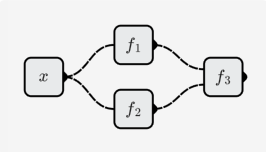

単項関数の場合と同様に、段階的に実装します。

- 単一のニューロンを使用して、関数のエッジをシミュレートします

- 次に、次の関数を取得できます。

- 最後に、次の関数を合成できます

最終的なニューラルネットワーク構造を次の図に示します。

その他のバイナリ関数

バイナリ矩形インパルス関数を使用すると、積分の原理と同じように、他のバイナリ関数を簡単に近似できます。

実験

Circleミッションを完了し、各ニューロンに対応する機能を観察します。

n 要素関数のシミュレーション

原理は同じです、あなた自身のために想像してください! 😥

質問

すでにデジタル回路とソフトウェアプログラムアルゴリズムがありますが、なぜニューラルネットワークが必要なのですか?

デジタル回路上に構築されたソフトウェアプログラムも任意の機能をシミュレートできるのに、なぜ人工ニューラルネットワークを発明するのでしょうか。